Efter att i maj ha presenterat planer på att bygga in generativ AI i sin samarbetsapplikation räknar Slack nu med att göra de nya funktionerna tillgängliga för utvalda kunder som en del av ett pilotprojekt i vinter, med en fullständig lansering nästa år.

Företaget har experimenterat med generativ AI internt under flera månader för att identifiera de bästa sätten att integrera tekniken för samarbetsändamål. Det initiala fokuset ligger på tre huvudsakliga användningsområden som är utformade för att spara tid genom att automatisera vissa processer.

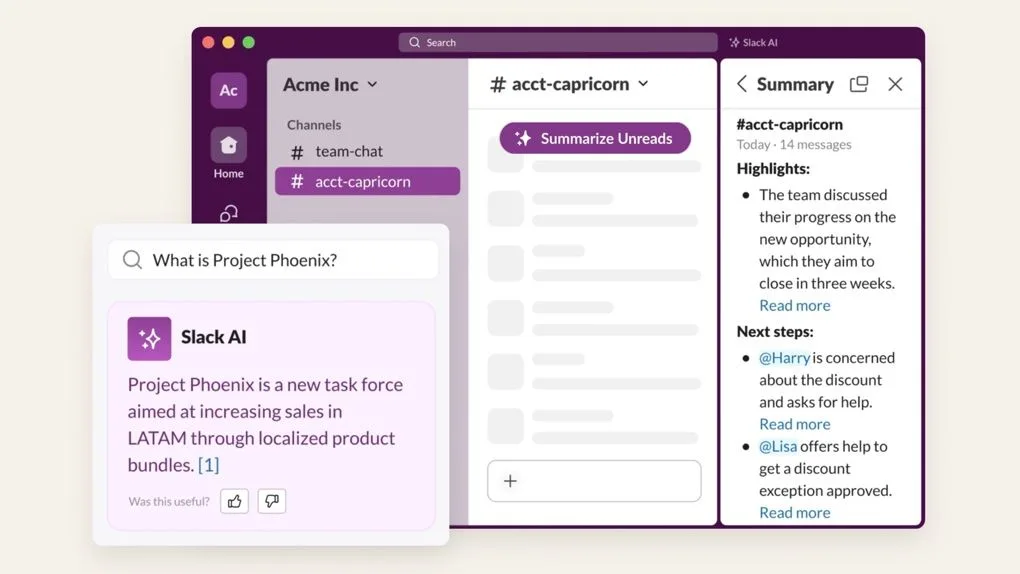

Ett av dessa är möjligheten att sammanfatta konversationer som äger rum i Slack-kanaler och -trådar.

– Folk hamnar i dessa superlånga konversationer i trådar; hundratals meddelanden”, säger Ali Rayl, senior vice president för produkthantering på Slack.

– Tanken är att du klickar på en knapp, AI går igenom tråden och säger: ”Här är vad som hände under de senaste fem timmarna”. Och istället för att läsa hela tråden får du en fin liten sammanfattning.

En annan liknande funktion är en planerad ”recap” av en kanal, som ger användaren en snabb sammanfattning av konversationer i en viss teamkanal. Om en användare har varit bortrest i ett par veckor – eller bara en dag eller två – och inte vill gå igenom en mängd meddelanden som kanske inte är relevanta, kan AI-verktyget ge en översikt över vad som har diskuterats.

Slutligen vill Slack använda genAI för att generera bättre svar när användare söker efter information i appen.

– Slack har alltid haft en sökfunktion – vi gör vårt bästa för att visa meddelanden och filer som är relaterade till din sökning”, säger Rayl.

– Men med hjälp av generativ AI kan vi ta detta ett steg längre: du kan ställa en fråga och vi kan gå igenom all information som ditt företag har i Slack och ge dig ett svar på exakt den frågan.

En användare kan till exempel fråga Slack om lanseringsdatumet för en produkt och omedelbart få ett specifikt datum, istället för att behöva bläddra igenom en lista med relaterade inlägg och länkar till dokument i sökresultaten för att hitta informationen.

Generativ AI kan göra samarbetet mer produktivt

Möjligheten att komma åt generativ AI-funktioner direkt från en samarbetsapplikation bör spara tid för användarna, säger Kim Herrington, senioranalytiker på Forrester.

– Vanligtvis vill man kunna utnyttja genAI på de platser och i de utrymmen där människor redan arbetar och kommunicerar för att maximera användarnyttan, säger Herrington.

Detta kan hjälpa en användare att snabbare gå ”från kunskapssökande till insikter” – och i slutändan till handling, säger hon.

Slack är inte ensamt om att väva in AI i sin programvara. Google och Microsoft, som också säljer applikationer för teamsamarbete, har gått vidare med sina egna generativ AI-pilotprojekt med kunder, till exempel, och, i Googles fall, redan tagit tekniken till marknaden.

Dessa initiativ markerar början på ”nästa fas, eller evolution”, inom gruppchattcentrerade arbetsytor, säger Mike Gotta, research vice president på Gartner.

Den fria utformningen av samarbetsverktyg – som används för att dela information, samordna arbete och upprätthålla medvetenheten om arbetsaktiviteter – kan leda till mycket brus, säger Gotta, och användare kämpar ibland med att hitta relevant information i applikationerna. Generativ AI kan hjälpa till genom att automatisera processer för att upptäcka ”dolda insikter relaterade till personer, ämnen, filer, uppgifter och skapa en sammanfattning av vad gruppen har diskuterat”, säger han.

Generativ AI kan också hjälpa nya teammedlemmar att snabbt återknyta kontakten med sina kollegor när de återvänder från en annan uppgift – en annan utmaning som användare ställs inför när de använder samarbetsappar.

– När man ”lämnar flödet” är det svårt att komma ikapp, säger Gotta.

Det finns också fördelar för chefer och teamledare, enligt Gotta.

– För dem som övervakar arbetet kan generativ AI vara ett självbetjäningssätt för att få kännedom om teamets övergripande leverans och även om det välbefinnande eller den oro som teamet har uttryckt genom sina chattinlägg, säger han.

Att hantera hallucinationer

Förutom de olika fördelarna med generativ AI i samarbetsappar finns det nackdelar med att använda stora språkmodeller (LLM) i affärssammanhang. LLM:er är benägna att drabbas av hallucinationer – felaktig information som svar på användarens instruktioner – och för Slack har problemet varit en del av utvecklingsprocessen för genAI.

En lösning som företaget har valt är att tillhandahålla transparens via citat eller länkar till varifrån informationen i en konversationssammanfattning kommer. Detta görs med en ”läs mer”-knapp som återför användaren till det ursprungliga meddelandet och kanalen som genererade sammanfattningen.

– Ofta är en sammanfattning faktiskt en syntes av fem eller sex olika meddelanden. Vi ger dig länkar till alla dessa, så att du kan gå tillbaka och dubbelkolla riktigheten – det är väldigt enkelt att se var allt detta kommer ifrån. Det här är ett sätt för oss att skydda oss mot hallucinationer, säger Ali Rayl.

Och om AI:n inte kan tillhandahålla en källhänvisning kommer verktyget inte att generera ett svar för att undvika fel.

Slack verkar också vara medvetet selektiva när det gäller var och när genAI används i deras app. Hallucinationer är vanligare när AI får för lite data, säger Rayl, vilket innebär att sammanfattningar av korta konversationer i huddles – Slacks röst- och videoverktyg – inte anses vara en bra matchning. Om en huddle bara är ett par minuter lång kan AI:n till exempel bara hitta på delar av en konversation för att göra en sammanfattning. Det är därför det är vettigt att begränsa användarnas interaktion med AI, säger hon.

– Det är den typen av begränsningar som vi vill hitta, där vi vet att AI kommer att misslyckas. Hur sätter vi in skyddsräcken så att människor inte hamnar i den situationen? I det här fallet är det typ: ”Om mötet bara är så här långt är AI:n inte tillgänglig, eftersom det inte finns tillräckligt att sammanfatta”.

LLM-verktyget har dock visat sig vara tillförlitligt för Slacks användningsområden, säger Rayl, särskilt för frågor som har faktabaserade svar.

– Vi har givetvis mycket information i Slack – vi använder Slack mycket för att få vårt arbete gjort – men vi är bara ett företag, så vi måste arbeta med våra kunder för att ta reda på: Fungerar det här för dem? Om inte, varför inte göra det bättre, och sedan rulla ut det till alla när vi är säkra på att vi har en riktigt bra produkt, säger Rayl.

Kundpilotprogrammet förväntas göra det möjligt för Slack att identifiera problem och finslipa användarupplevelsen innan en bredare lansering.

Samarbete, AI och dataintegritet

Med begränsade verktyg i företagsklassen har generativ AI i princip existerat som en form av ”skugg-it” sedan förra året, med anställda som själva använder tjänster som OpenAI:s Chat GPT. Om man gör det riskerar man att skicka känsliga företagsdata till ett annat företags servrar.

En av fördelarna med att bygga in generativ AI-funktioner direkt i samarbetsappar är att data förblir under kontroll av kundorganisationen.

– Användarnas frågor används inte för att träna någon annans modell. De används inte ens för att träna den modell som vi kör. Vi kör en fristående LLM som säkerställer att data inte läcker mellan kunder och att data inte går ut på internet, säger Rayl.

Rayl påpekar också att Slacks AI inte ger medarbetarna tillgång till konversationsdata som de normalt inte har tillgång till i sin arbetsyta. Detsamma gäller för filer och dokument som är tillgängliga för användarna.

– AI:n har tillgång till samma data som vår befintliga sökupplevelse har tillgång till. Så om jag gör en sökning efter något som finns i en kollegas DM:s kan jag inte se det. Men om jag gör en sökning efter något som finns i mina DM:s kan jag se det. Samma sak med privata kanaler: om du har tillgång till dem kan AI söka på dem, om du inte har det kan de inte det.

I grund och botten är det samma sökupplevelse som i Slack, men ”med ett lager av AI för att förstå, syntetisera och svara på frågor”, säger Ali Rayl.

– Generativ AI är i ett mycket tidigt skede, så frågor om säkerhet, efterlevnad, integritet och medarbetarnas acceptans kommer fortfarande att ligga högt upp på listan över frågor som organisationer oroar sig för, säger Mike Gotta på Gartner.

– Det kommer att ta tid att normalisera generativ AI, minska oron över noggrannhet och hantera eventuella relaterade frågor om prissättning kontra avkastning på värde.